2.3. ARTICULACIÓN FONOLÓGICA Y FONÉTICA

“Cada configuración articulatoria del emisor se corresponde con unas características acústicas específicas de la señal que el oyente considera a fin de discriminar los indicios que necesita para la percepción o decodificación del mensaje recibido” (Llisterri, J. y otros, 1999).

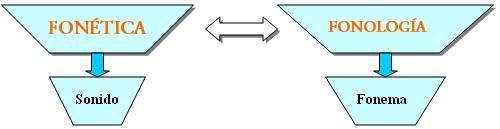

La fonética trata de los sonidos del lenguaje (parte fónica expresiva) y se refiere a los sonidos (acústica) y cómo son pronunciados (fonemas).

La discriminación fonemática le permitirá al niño diferenciar y reconocer los elementos fundamentales del lenguaje articulado. Convendría aclarar que fonética y fonología aparecen íntimamente interrelacionadas, puesto que mientras la fonética estudia la emisión de los diversos sonidos, la fonología establece y fija los elementos que diferencian a estos sonidos, según la lengua en la que nos situemos.

Figura 2.3.a. Interrelación entre Fonética y Fonología.

El logopeda podrá hacer el entrenamiento en este nivel desarrollando:

- Ejercicios de imitación de la posición tipo.

- Posibilitando al alumno que perciba la vibración y la sonoridad a través del tacto.

- Desarrollando juegos onomatopéyicos de imitación de voces y ruidos.

- Repitiendo vocalizaciones de palabras y frases formuladas previamente.

Navarro Sierra, J.L. (2000) refiere que todos los programas que trabajan la producción vocal y corrigen las alteraciones del habla siguen estos 3 procedimientos:

- Recogen la señal sonora emitida a través del micrófono.

- Analizan uno o varios de sus atributos.

- Devuelven información visual a través de la pantalla.

Sin embargo, a la hora de trabajar este apartado con ayuda de los medios informáticos, mencionaremos aquellos programas que van a posibilitar el feed-back auditivo, es decir, los que recogerán la emisión sonora del alumno (de forma visual o cinestésica), frente a los que no lo realizan. Puesto que hay algunos programas informáticos que permiten ese tipo de interacción, este hecho no es debido a que diferencien entre los núcleos silábicos y los márgenes silábicos, sino que seremos los logopedas quienes demos validez a la emisión sonora permitiendo la oposición de los órganos articulatorios mientras se produce la emisión del sonido, ya que dichos programas no efectúan la contrastación o diferenciación entre el posicionamiento que adoptan los órganos durante la emisión de los vocales, sino que se centran en la diferenciación de frecuencias sonoras (frecuencia, vibración armónicos) de los núcleos silábicos (21). Son dos clases de programas informáticos: los receptores de la emisión vocálica y programas gráficos de la voz.

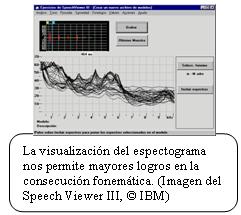

Figura 2.3.b. Visualización de un Espectograma.

Bajo el primer nivel, programas “receptores de la emisión vocálica”, encaminarán su intervención y corrección hacia:

-

La precisión del fonema, esto es, a conseguir que la emisión fonológica del paciente se aproxime al patrón vocal prefijado (medido en la frecuencia) y previamente grabado por el terapeuta o colaboradores. El objetivo será evaluar la capacidad articulatoria, como definen Gallego, J.L. y Gallardo J.R. (1995). Para ello, hablaremos de programas como el Speech Viewer III (ejercicios de precisión de fonemas), del Sistema Avel (colorear dibujos, juego de los globos y Avelino) o del programa Fonospain ( http://w3.cnice.mec.es/eos/MaterialesEducativos/mem2001/sonidos/index.html), donde se muestra la visualización de los movimientos de emisión de cada fonema, como hecho informativo.

-

Contraste del fonema (22) . Algunos programas como el Speech Viewer III (actividad de contraste de 2 fonemas y contraste de 4 fonemas) y el Sistema Avel (Juego del laberinto y las canastas) o el propio Voxmetria, que establecen la diferenciación de las frecuencias entre 2 o más fonemas. Nos permiten adquirir el sistema fonológico y corregir los posibles errores cometidos por el cambio de posicionamiento de uno de los órganos fono-articuladores ocasionado durante la emisión, permitiendo la precisión en la pronunciación de dicho fonema. Sin embargo, antes de efectuar esta actuación habremos grabado un patrón de voz, el cual servirá de modelo – comparando la frecuencia emitida con la registrada – al alumno o al paciente, y le posibilitará corregir el fonema incorrecto. Convendría indicar al logopeda que a la hora de grabar los patrones modelo de cada uno de los fonemas, realice la grabación de estos con 3 tipo de voces (niño, hombre y mujer), como sucedía con el programa SAS (Tarjeta Visha), pues sino, cuando el programa compare el resultado de la emisión vocálica emitida por el niño/a o paciente con modelos previamente grabados, si no corresponden al mismo tiempo, frecuencia y género, el resultado puede resultar desalentador. De tipo más sencillo, aunque menos eficaz, destacaremos las actividades de laberinto y dibujos para colorear del Sistema Avel. Más complejo, aunque en desuso, fue el programa SAS que incorporaba 6 patrones o modelos de voz para poder comparar la producción de las vocales únicamente, o el propio Sedea, que llega a incorporar voz susurrada, impostada y conversacional, tanto la de hombre como la de mujer. Como comentario, podemos indicar la necesidad de que en un futuro, tal vez se pueda disponer de patrones indicativos que permitan al alumno reconocer a modo de “visu”, si las incorrecciones de los fonemas emitidos se han debido a motivos de sustitución, distorsión, omisión o traslación, pero estamos hablando de un futuro próximo. En un plano más sencillo, el mencionado programa Discriminación Auditiva del C.P. Ezcaray, que trabaja la identificación de las palabras según su emisión fonológica.

-

Visualización del fonema: emisión espectográfica y/o sonográfica. La visualización gráfica de las emisiones sonoras ha supuesto una gran apuesta del campo de la audiología a la logopedia, pues programas como el PC Vox (de la Tarjeta Visha) se han visto ampliamente desarrollados por el Sistema Avel, Voxmetria y, en especial, por el Speech Viewer III (actividades de estructuración de tono e intensidad). Ello no quita mérito a los primeros programas pioneros en este sentido, como han sido el LAO, Phonos (proyecto Musa), y el reciente Osciloscopio (Proyecto Fressa), que han tratado de incorporar los elementos reconocedores de la voz y del sonido con ayuda de las nuevas tecnologías, aunque la resolución de sus gráficos y el disponer de periféricos diferentes que podían chocar con las tarjetas de sonido estándar han hecho relegar a un segundo plano, o incluso desaparecer su uso, dejando paso a programas tan efectivos como el propio Speech Viewer III. En este ámbito corresponde al logopeda realizar la confección de un modelo espectográfico del fonema (23) que nos servirá de base para efectuar aproximaciones por parte del paciente. Aproximaciones tendentes a trabajar la vibración, el tono y la frecuencia sonora. Como limitación a esta aportación, el considerar que para hacer un espectograma de un sonido puro se requieren una serie de condiciones muy concretas, tanto en el espacio físico, donde se desarrolla la sesión (ambiente insonorizado), como en el estado de la voz del paciente: el timbre (sonoridad y tonalidad). Sin embargo, podemos hacer uso por el feed-back visual que proporciona al hablante (24).

Figura 2.3.c. Pantalla del programa Fono.

21. Son recomendables las lecturas de algunos de los proyectos de investigación del Laboratorio de Fonética de la Universidad de Barcelona http://www.ub.es/labfon/labc.htm

22. En palabras de Antonio M. Ferrer (2002): “cuando se hace uso de los ejercicios relativos a segmentos lingüísticos (precisión, encadenamiento, contraste de fonemas – como es este caso--), el programa siempre compara la ejecución que recoge del niño/a con un modelo previamente grabado. Ante ello los patrones orales de las personas sordas están muy alejadas de la norma, de modo que, aun consiguiendo producciones que para el oído humano resultan completamente inteligibles respecto a su objetivo, el programa las puede considerar erróneas al contrastarlas con el modelo “no sordo”.

23. Permite comparar varios espectros del mismo fonema, comparándolo con otro del mismo paciente en otro momento dado, o con el patrón modelo disponible por el logopeda, así como enmarcar una onda acústica o campo espectográfico concreto con el que hacer un estudio más pormenorizado de cada dificultad y de cada avance y logro.

24. Ver apartado de Disfonía, contenido en el capítulo II de este informe.

|